Naście lat temu wszystkie korporacje technologiczne wprowadzały dziwne polityki prywatności, bo chciały zebrać maksimum informacji o użytkownikach dla nacelowywanych reklam.

To nadal było jednak za mało, bo każdy klient i każdy produkt powinien być źródłem ciągłego strumienia wartości płynącego do producenta.

Stąd stopniowe przechodzenie wszelkich usług na model subskrypcyjny, a nawet wprowadzanie ich do produktów fizycznych, gdzie fabrycznie wbudowane funkcjonalności zamykane są za barierą abonamentu (Mercedes). Kolejną alternatywą jest wyciskanie z klientów wzrastających opłat za obsługę dalszego cyklu życiowego produktu (John Deere) albo wprowadzanie reklam w miejsca, gdzie wcześniej miało ich nie być (Samsung, samochody). Niczym niezwykłym nie jest też subsydiowane domykanie monopolu, które zostaje następnie skonsumowane drastycznymi podwyżkami kosztów użytkowania.

Jeff Bezos chciałby również, abyśmy porzucili przestarzały model posiadania własnych komputerów i wynajmowali po prostu moce technologiczne od niego.

Wszystko i wszyscy mają być ciągłym źródłem danych i/lub przychodu. Opór przed nadzorem jest już niemal bezcelowy, bo skuteczna ucieczka wymaga nagięcia do tego celu całego swojego życia.

Teraz na dokładkę wciskają nam, gdzie popadnie AI, żeby pozyskać nowe dane do treningu, reklamy i… kto wie czego jeszcze? Czy nam się to podoba i w czymkolwiek pomaga, czy też nie.

Motywacją mają być usprawnienia dla użytkownika i rzekome przyszłe profity dla firm. Czy spina się to w ogóle w jakąkolwiek sensowną całość?

MODEL BIZNESOWY

Główne branże związane aktualnie z AI dzielą się na cztery główne sektory (uwzględnianie dodatkowych nie ma większego sensu, bo to fistaszki):

- Projektowanie i produkcja sprzętu.

- Infrastruktura chmurowa.

- Konstruowanie i trenowanie bazowych modeli generatywnych.

- Programy wykorzystujące sztuczną inteligencję.

Wiele firm łączy też kilka z powyższych opcji i oferuje je niejako w zwartym pakiecie. Uzyskiwanie przychodu może odbywać się na kilka różnych sposobów:

- Zakup jednorazowy – to przede wszystkim dotyczy samego sprzętu.

- Wynajem licznikowy – opłaty ustalane na podstawie ilości wykonywanych obliczeń.

- Stały abonament / subskrypcja – dostęp do narzędzia AI przez jakiś okres.

- Reklama – zapłata ma formę prywatnych danych użytkownika i wyświetlania mu ogłoszeń.

Model żerowania na uwadze, a więc zbierania informacji o użytkowniku i / lub serwowania mu reklam to niejako ścieżka domyślna dla Google i Meta. Wydaje się, że na taką ścieżkę zdecydowało się także OpenAI, choć oni chcą jednocześnie pobierać abonament.

Żaden z powyższych modeli biznesowych – z wyjątkiem faktycznej produkcji kart graficznych – nie jest w tej chwili opłacalny i nic nie wskazuje na to, aby miało się to zmienić. Być może wynajem infrastruktury miałby kiedyś szansę również przynosić dochody, ale biorąc pod uwagę aktualne koszty GPU oraz szykującą się gigantyczną nadpodaż centrów obliczeniowych może być z tym kiepsko. Już teraz szacunki wskazują, że firmy nie zarabiają na wynajmie farm kart graficznych dla AI.

Dla czystego abonamentu bez reklam – zwłaszcza w sekcji premium dla wymagających użytkowników – istnieje bardzo poważna przeszkoda: koszty, zamiast maleć, rosną.

Generowanie pojedynczych tokenów (w uproszczeniu: słów / sylab) co roku staje się ok. 10 razy tańsze, więc sytuacja wygląda z pozoru optymistycznie. Użytkownicy nie chcą jednak korzystać z przestarzałych czy ograniczonych wariantów i zawsze oczekują narzędzia o maksymalnych zdolnościach. Wprowadzane są więc nowe modele, a z tym wiąże się namnażanie wykorzystywanych tokenów.

Wirtualni asystenci mogą przetworzyć coraz większe zbiory danych od użytkownika, wprowadzane są tryby „deep research” (model samodzielnie przegląda internet) i wnioskowania pośredniego (AI sprawdza dodatkowo etapy własnego rozumowania), co oznacza dodatkowe obliczenia. Co gorsza, modele mogą też być uruchamianie przez użytkowników w równoległych instancjach. Wszystko to sprawia, że ilość zużywanych tokenów wzrasta szybciej, niż spada ich cena.

Firmy próbują dynamicznego przełączania pomiędzy modelami bardziej i mniej złożonymi w zależności od zapytania, aby ciąć koszty. Alternatywnie, przerzucają obliczenia na komputer użytkownika. To jednak nie działa, bo króluje model subskrypcyjny ze stałą ceną, ponieważ nikt nie chce płacić rachunków uzależnionych od liczby zużytych tokenów.

Takie okoliczności wprowadzają producentów wirtualnych asystentów w ślepy zaułek. Chcąc zarabiać, powinni naliczać opłaty za zużycie – wtedy jednak użytkownicy przeniosą się do konkurencji. To samo nastąpi, jeśli spróbują znacząco zwiększyć ceny subskrypcji. To prowadzi do sytuacji, gdzie wszystkie firmy starają się nawzajem zagłodzić, pomnażają wspólne straty i nieustannie wymagają nowych rund finansowania.

Jedną ze strategii przetrwania kryzysu jest skupienie się na użytkownikach korporacyjnych i „uwięzienie” ich w swoim oprogramowaniu, a następnie odcinanie od tego kuponów. Dla branż, gdzie odpowiednie wdrożenie AI jest bardzo wymagające, a późniejsza zmiana dostawcy ekstremalnie kosztowna i biurokratycznie bolesna, może to być wykonalne. To jednak z pewnością zbyt mała nisza dla całej branży sztucznej inteligencji.

KOSZTY INWESTYCYJNE

Koszty budowy centrów obliczeniowych dzielą się pomiędzy trzy główne składniki – ziemia i budynek (25%), infrastruktura (40%) oraz karty graficzne (35%). Czipy w centrach obliczeniowych, które miały zostać wybudowane w 2025, będą się deprecjonować w tempie 40 mld dolarów rocznie generując w tym czasie 15-20 mld dolarów obrotu. Jeśli przyjąć, że narzut na usługach AI miałby wynosić 25%, to potrzebne jest 160 mld przychodu, żeby zrównoważyć samą deprecjację. Żeby uzyskać zwrot rzędu choćby 20% z zainwestowanego kapitału – co nie jest oszałamiającym wynikiem – przychody musiałyby wynieść 480 mld. To 5 razy więcej, niż MS Office, a te liczby dotyczą wyłącznie centrów obliczeniowych z 2025 r.!

Tak przynajmniej brzmi analiza Harrisa “Kuppy” Kuppermana, założyciela funduszu Praetorian Capital.

Tymczasem aktualny obrót związany z AI wynosi około 2.5 mld $ miesięcznie (optymistyczne 30 mld rocznie), z czego 94% zamyka się w 10 największych firmach. To o kilka rzędów wielkości za mało.

Ale to dopiero początek, bo całościowe liczby są o wiele bardziej szokujące. Inwestycje w centra obliczeniowe już wykonane i planowane do 2028 roku to niemal 3 biliony (trzy tysiące miliardów) dolarów! Połowa z tego ma pochodzić od tzw. firm hiperskalowych (np. Alphabet, Microsoft).

W tym momencie luźna forsa skończyła się nawet w spółkach takich jak Google, Amazon, Meta czy Oracle. Wszyscy muszą zaciągać potężne długi, żeby kupować czipy Nvidii, a nikt nie ma planu jak zarabiać na AI.

Sama Nvidia jest uzależniona nie od swoich klientów, ale ich zdolności do dalszego pozyskiwania finansowania. Środki te właśnie się wyczerpują, bo bankom najpierw zwyczajnie zaczęło brakować funduszy – na co wskazywało coraz częstsze sięganie do tzw. „okna dyskontowego” FED od 2024 roku – a teraz zaczęły się wręcz wycofywać z inwestycji w AI. Kupcy zaczęli więc sięgać do coraz bardziej podejrzanych źródeł, łącznie z sektorem tzw. „shadow banking”.

Wszędzie pełno dziwnych machinacji finansowo-księgowych, które wybielają rzeczywistość. Przykładami są: wydłużanie czasu amortyzacji kart graficznych i przechowywanie ich w magazynach, żeby nie wykazywać w księgach amortyzacji; wynajmowanie przyszłych centrów danych, żeby nie musieć płacić za ich budowę już teraz; trik rachunkowy znany jako „budowa w toku”, itd.

Odbywa się również mnóstwo operacji, których celem ma być po prostu podbijanie notowań giełdowych lub wycen startupów. Można tutaj wymienić ruchy pozorowane, które mogą skończyć się na zapowiedziach (listy intencyjne, inwestycje warunkowe, deklaracje przyszłych zakupów) oraz faktyczne inwestycje kołowe, często oparte o dług, w czym uczestniczą prawie wszystkie banki i instytucje finansowe.

AI pochłonęło już większość zasobów venture i private capital, ale tych inwestycji nie udaje się spieniężyć, bo nie ma przychodów, a w związku z tym ma miejsce kryzys płynności finansowej. W konsekwencji rentowność funduszy gwałtownie spadła od czasu pobłogosławienia AI. Teraz w grę wchodzą już nawet przeróżne derywaty zabezpieczane aktywami, co może wzbudzać niepożądane skojarzenia.

DLACZEGO TO SIĘ DZIEJE?

Zakup czipów ma sens tylko jeśli jesteś w stanie zarobić na ich wykorzystaniu lub wypożyczaniu ich mocy obliczeniowej. Jest tu tylko jedna firma, która zarabia na całym procederze: Nvidia. Czemu zatem inni tak ochoczo uczestniczą w tym owczym pędzie?

W rękach Google jest 90% rynku wyszukiwarek. Wydawać by się mogło, że to świetna wiadomość dla firmy, ale w rzeczywistości to dramat. Dlaczego?

Bycie firmą wzrostową oznacza, że jej akcje są wyceniane nieproporcjonalnie wysoko, ponieważ inwestorzy wliczają do ceny oczekiwany dalszy rozwój. To z kolei przekłada się na wyższe premie dla zarządu i pracowników, bezproblemowy dostęp do długu oraz łatwiejsze przejmowanie mniejszych firm i startupów. Dodatkowo zapewnia to uwagę mediów, nimb wizerunkowy i darmową reklamę. W tym samym czasie korporacja może też samodzielnie kreować nowe akcje! Co więcej, inwestorzy nie oczekują nawet wypłacania dywidendy!

Kiedy firma przestaje rosnąć i osiąga status dojrzałej, to wyceny się normalizują i już nie jest tak różowo. Kluczowi pracownicy, którzy byli do tej pory wynagradzani akcjami, zaczynają się domagać podwyżek, a w przeciwnym razie opuszczają pokład. Pożyczki nadal można uzyskać, ale trzeba się o nie postarać. Za przejmowane startupy trzeba płacić faktycznymi dolarami, a nie tylko własnymi akcjami. Inwestorzy mogą się też zacząć domagać części zysków.

Dlatego korporacje technologiczne nieustannie pompują bańkę za bańką i przepuszczają miliardy na kolejne bzdety: kryptowaluty, NFT, metawersy czy AI. Celem jest wmówienie rynkowi, że kolejna rewolucja jest zawsze tuż za rogiem i kolejne lata wzrostu nadal przed nami. W ten sposób giełda staje się kasynem.

To już totalna degeneracja strategii inwestycyjnej, gdzie taktyką nie jest już nawet subsydiowanie startupów przez lata w oczekiwaniu przyszłych dochodów (Uber, AirBnB), ani generalny brak modelu biznesowego (Metaverse). Firmy AI przynoszą olbrzymie straty i mają tak gigantycznie napompowane wyceny, że niebawem musiałyby debiutować z monstrualnymi wycenami. Uznane firmy technologiczne z entuzjazmem włączają się w modny trend, bo właściwie czemu nie. Tak więc liczy się tylko maksymalny wzrost, bez względu na cenę. To jest bezrefleksyjne błędne koło, ale ekstaza hajpu sprawia, że nikt nie zadaje „zbędnych” pytań.

Wciąż mnożą się natomiast kolejne rzekome zastosowania produktowe w postaci okularów z kamerkami, inteligentnych telewizorów i multimodalnych robotów. W mediach nie ma jednak miejsca na piętnowanie tego ślepego pędu albo chociaż zwykłą krytykę czy wątpliwości. Nadal króluje entuzjazm, zapowiedzi rewolucji i nieuniknionego wzrostu.

Punktem odniesienia nie jest to, czego firmom udało się dokonać, ale tylko ich potencjał, panujący wokół nich klimat oraz kolejne wagony pieniędzy, które zostały zainwestowane. Startupy są celebrowane nie za świeże pomysły czy tworzenie realnego biznesu, ale skuteczne pranie mózgów inwestorów. To mechanizm, który nagradza hochsztaplerkę.

Pierwotny model zgównienia platformowego wyglądał tak:

- Firma stara się zbudować monopolistyczną platformę, więc jest dobra dla użytkowników, aby ich pozyskać, uwięzić i zasysać ich dane. Moment w którym się to udaje, jest ostatnim, kiedy przedsiębiorstwo może jeszcze udawać, że działa pod wpływem szlachetnych pobudek.

- Użytkownicy schodzą na dalszy plan, bo prawdziwym klientem korporacji są firmy chcące kupować targetowane reklamy. Ludzie korzystający z platformy ubolewają, ale działy marketingowe celebrują.

- Klienci-reklamodawcy schodzą na dalszy plan, bo są uwięzieni: i tak muszą płacić za promowanie swoich produktów na platformie, bo nie mają alternatyw. Ceny za to rosną, co podbija notowania spółki, więc posiadacze akcji są zadowoleni.

- Inwestorzy są nabijani w butelkę poprzez pompowanie kolejnych niedorzecznych baniek obiecujących dalszy rozwój firmy. Kreski na wykresach pną się w górę, hajp wokół szumnych zapowiedzi zamiera, ale dzięki monopolizacji wielkie korporacje technologiczne nadal wykazują zdrowe zyski, więc inwestorzy zaczynają ignorować racjonalną wycenę wartości spółek cyfrowych.

Ostatni etap to właśnie wynalazek ostatnich lat, który wszyscy powinniśmy mieć w pamięci. Wszelkie pochwały proszę kierować w kierunku Eda Zitrona (gorąco polecam jego bloga), bo sam niestety tego nie wymyśliłem.

NA BANI

Akcje Nvidii rosną w portfelach funduszy emerytalnych i prywatnych inwestorów, tymczasem 88% jej przychodów – szacowanych w tym roku na ponad 400 mld $ – stanowi sprzedaż czipów dla centrów obliczeniowych. Co stałoby się, gdyby gwałtownie spadł popyt na jej główny produkt?

Firma ma wprowadzać nowe karty co roku i mają być one coraz wydajniejsze pod względem zużycia prądu. To może z kolei sprawiać, że wszystkie starsze GPU momentalnie staną się nieopłacalne w użytkowaniu.

Ponadto technologia wykorzystywana przez Nvidię może być w pewnym sensie przestarzała, ponieważ jej czipy, o ile mi wiadomo, nadal opierają się na klasycznej architekturze kart graficznych, która jest dosyć uniwersalna, ale prądożerna. Google natomiast samodzielnie projektuje własny silikon o konstrukcji zoptymalizowanej pod obliczenia dla sztucznej inteligencji (ASIC) i zleca produkcję bezpośrednio w tajwańskim TSMC. Swoich czipów nie sprzedaje jednak na zewnątrz. Rywale zaczynają więc kombinować w tym kierunku na własną rękę.

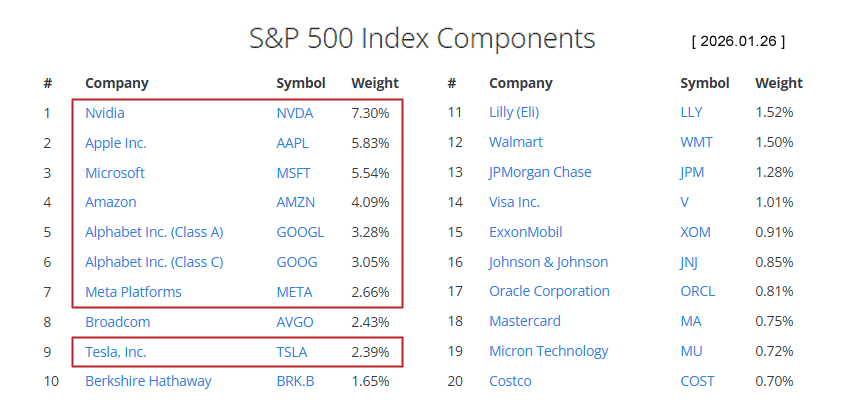

Firmy wchodzące w skład tak zwanej „wspaniałej siódemki” – Alphabet, Amazon, Apple, Meta, Microsoft, Nvidia i Tesla – stanowią aktualnie jedną trzecią indeksu S&P 500 (sama Nvidia to ok. 7%), podczas gdy w 2020 było to ok. 20%.

Bańka już teraz jest o wiele gorsza niż ta z 2000 roku. Wtedy amerykańskie firmy venture capital zainwestowały w sumie – przez cztery lata – odpowiednik dzisiejszych 344 mld dolarów. Czyli dwa razy więcej, niż włożyły w sztuczną inteligencję w samym roku 2025. To jednak tylko fundusze VC. Od roku 2022 zainwestowano w AI niemal bilion dolarów, a może i więcej. Wedle deklaracji zabawa dopiero się rozkręca.

W 2000 roku barierą dla sukcesu napompowanych firm był kiepski dostęp do internetu wśród potencjalnych klientów. Teraz każdy może używać czatbotów, nawet bez płacenia! Problemem jest sama technologia LLMów.

W przypadku Dot Com pejzaż wypełniał cały archipelag firm i startupów, teraz wszystko opiera się na Nvidii. Ich czipy są drogie i potrzeba ich mnóstwo, a do tego konieczna jest jeszcze budowa centrów danych. Wszyscy zapożyczają się albo od początku, albo od niedawna. Zarabia tylko Nvidia! Taka sytuacja nie może trwać w nieskończoność.

Koszt pojedynczego tokena spada, ale ich wykorzystywana ilość na zapytanie rośnie, więc koszty i straty nadal się piętrzą.

Startupy są tworzone na bazie założenia, że koszty będą maleć, ale to nie ma miejsca, więc ich cały model funkcjonowania nie ma racji bytu. Centra danych są cały czas budowane z wizją tego, że usługi AI staną się bardziej przystępne cenowo, co prowadzi do przeinwestowania. Fundusze wysokiego ryzyka inwestują w AI na bazie obu poprzednich założeń.

25 lat temu istotną częścią giełdowej ekstazy były światłowody, z których korzystamy do teraz. Tym razem częścią infrastrukturalną bańki są centra obliczeniowe oraz będące ich sercem GPU. Niestety karty graficzne to nie światłowody:

- Wymagają większego wkładu finansowego na zakup i zbudowanie dla nich infrastruktury.

- Potrzebują większych kwot związanych z wykorzystaniem (prąd).

- Nie są tak uniwersalnie przydatne i dostępne.

Kto miałby korzystać z centrów obliczeniowych oprócz firm AI? Chyba przede wszystkim kopacze kryptowalut. Co więcej, farmy obliczeniowe mają krótki okres przydatności, a karty się dezaktualizują i zużywają – w przeciwieństwie do światłowodów.

Żeby zrealizować swoją wycenę, nawet Nvidia musiałaby osiągać niemożliwe profity, za które ktoś inny musi jeszcze zapłacić. Tymczasem nikt nie zarabia na AI, a nawet ciągle musi się zadłużać! Przez to, jak działa rynek technologiczny konsekwencje będą natomiast globalne.

PODSUMOWANIE

Każda bańka inwestycyjna w końcu pęka i transferuje oszczędności zwykłych ludzi do majątków oligarchii. Z bańki Dot Com zostały światłowody. Po szale na AI centra danych będą rozprzedawane na części za bezcen, a wcześniej pogorszą warunki życia dla wszystkich sąsiadujących z nimi ludzi.

Już od jakiegoś czasu kluczowi bogacze-prezesi zaczęli wydzielać z siebie ciekawe wypowiedzi:

Sundar Pichai (Alphabet): W boomie na AI są elementy irracjonalne. Żadna firma nie uniknie konsekwencji ewentualnego krachu.

Jeff Bezos (Amazon): Sztuczna inteligencja jest rodzajem bańki technologicznej.

Sam Altman (OpenAI): Jest wiele sektorów AI, które wydają mi się napompowane oczekiwaniami.

Satya Nadella (Microsoft): Jeśli to nie miałaby być bańka, to konieczne jest, aby korzyści ze sztucznej inteligencji były bardziej równomiernie rozłożone.

Facet, który przewidział poprzedni kryzys finansowy (Michael Burry), również jest przekonany, że taka sytuacja jest niemożliwa do utrzymania. Od jakiegoś czasu szortuje on akcje Nvidii (gra na ich spadek) twierdząc, że to firma najbardziej narażona na krach spowodowany przez AI. Pewnie preferowałby on obstawiać inne spółki, ale większość z nich to albo dochodowe kolosy (Google, Microsoft), albo firmy jeszcze przed swoim giełdowym debiutem (np. OpenAI).

W mojej ocenie krach giełdowy jest nieunikniony, co wywoła potężne wstrząsy wtórne w innych rejonach. Wszystkich następstw przewidzieć się nie da, ale na pewno będą one potężne. Miliarderzy zapewne wyjdą z tego bez wielkiego szwanku, a zapewne nawet bogatsi niż kiedykolwiek. Ktoś jednak będzie musiał opłacić rachunek.

Ja obawiam się nie tylko tego, ale i dodatkowych konsekwencji społeczno-politycznych związanych ze sztuczną inteligencją i nagłym nadmiarem mocy obliczeniowych potrzebujących jakiegoś wykorzystania. O tym w kolejnym poście.

Dodaj komentarz