Usilnie forsowane wprowadzanie sztucznej inteligencji to eksperymentem na żywym organizmie. Nikt nie jest w stanie przewidzieć, jakie będą rezultaty, a procesu nie da się do końca kontrolować.

Wydaje się, że początkowo podnoszone obawy były przedwczesnym wykwitem wyobraźni opierającym się na kliszach science-fiction, jeśli nie fortelem mającym zakamuflować faktyczne zagrożenia i zamiary głównych aktorów dramatu.

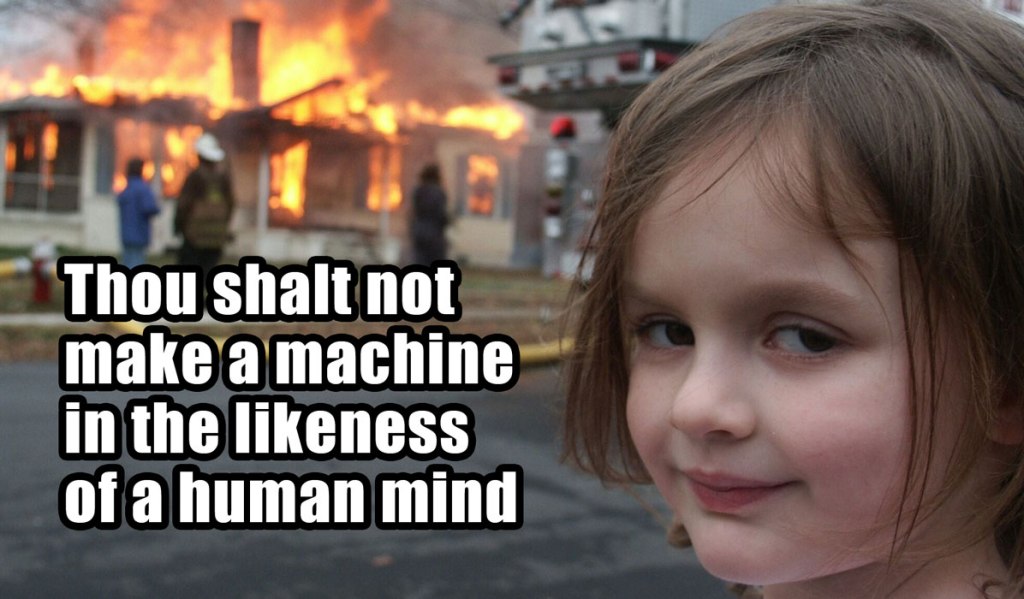

Moje stanowisko w tej chwili można skrótowo sprowadzić do cytatu z Diuny:

„Nie będziesz czynił machin na obraz i podobieństwo umysłu ludzkiego.”

…a przynajmniej nie w taki sposób, jak jest to obecnie realizowane.

Nosiłem się z tym tematem już chyba z rok, sytuacja zdaje się wypełniać moje przewidywania, więc w końcu zebrałem się do opisania własnej perspektywy.

W dalszej części zarysuję generalny obraz sytuacji, który zamierzam mocno uszczegółowić w kolejnych tekstach. Zapraszam do krytyki, bo moje wizje są bardzo mroczne i naprawdę chciałbym się mylić.

PLUSY AI

W dziedzinach, gdzie istnieje powtarzalna i dobrze udokumentowana struktura działania, modele mogą pomóc z jej nauką, a nawet zastąpić użytkowników w mechanicznych działaniach (np. programowanie czy analiza obrazu). Uczenie maszynowe jest też w stanie rozwiązywać złożone problemy ze sztywną strukturą algorytmiczną, co zostało już zademonstrowane w przypadku modelowania białek czy wspierania dowodzenia matematycznego. Konieczne jest jednak specjalne przygotowanie modelu do danej dziedziny, a nie proste przeszczepienie ogólnego modelu językowego na nowy grunt.

Wydaje się też, że LLMy mogłyby się dobrze sprawdzać jako interfejs pośredniczący między człowiekiem a innymi programami. Dzięki temu teoretycznie możliwy byłby łatwiejszy dostęp do bardziej złożonych funkcjonalności, które bez takiego wsparcia wymagałyby relatywnie skomplikowanych i czasochłonnych działań ze strony użytkownika. Do głowy przychodzi mi przeszukiwanie i podsumowywanie danych nawet na podstawie niezbyt precyzyjnie sformułowanych oczekiwań czy tłumaczenie instrukcji przeznaczonych dla maszyn (np. JSON) do formy łatwiej przyswajalnej dla człowieka.

Modele językowe całkiem dobrze funkcjonują już teraz jako narzędzia tłumaczące, stenograficzne czy redagujące teksty, o ile tylko nie jest wymagana pełna wiarygodność czy oddanie zamiaru artystycznego twórcy. Istnieje oczywiście wiele innych wartościowych działań, w których AI sprawdza się całkiem nieźle, ale zawsze ostateczną barierą jest właśnie kwestia zaufania. Jeśli zatem użytkownik potrzebuje wykonać coś na szybko, roboczo, w przybliżeniu i sam nie ma do tego cierpliwości lub zdolności, to model generatywny może bardzo pomóc. Należy tylko mieć świadomość, że rezultat może zawierać defekty, a nawet istotne wypaczenia czy braki.

MINUSY AI

Sposób funkcjonowania modeli generatywnych jest immanentnie oparty o losowość, bo bez niej proces nie byłby w stanie poprawnie funkcjonować. Z tego względu halucynacje są nieuniknione, a generowane przez maszynę produkty należy traktować podejrzliwie. W szczególności dotyczy to bardziej złożonych zadań, bo im dłużej trwa przetwarzanie, tym bardziej rośnie prawdopodobieństwo wystąpienia błędów. Tymczasem defekty pojawiające się na wcześniejszym etapie działań mogą stopniowo narastać do postaci lawiny.

Dlatego sztucznej inteligencji – przynajmniej w jej aktualnej postaci – nigdy nie należy darzyć pełnym zaufaniem. Co więcej, tak naprawdę jest to narzędzie najbardziej nadające się dla osób, które są w stanie zweryfikować rezultaty jej pracy. Brak znajomości danej dziedziny czy zwykłe lenistwo oznacza, że polegamy na niepewnych efektach zwracanych przez AI. Obawiam się, że większość ludzi będzie się posługiwać wpychanymi im narzędziami właśnie w taki, niebezpieczny, sposób. Zwłaszcza że korporacje wcale nie są skore do formułowania przestróg i zastrzeżeń, a czatboty dość rzadko przyznawały się dotychczas do niewiedzy lub niezdolności do wykonania zadania.

Co więcej, wydaje się, że modeli generatywnych nie da się skutecznie zabezpieczyć, bo zawsze znajdą się triki, które obchodzą wznoszone bariery.

Kolejną przeszkodą wydaje się ograniczony zasób danych dostępnych do treningu modeli. Cały internet został już w zasadzie zarchiwizowany, a do szkolenia wykorzystywane muszą być też materiały syntetyczne, czyli generowane sztucznie. Kolejnym krokiem wydaje się zatem pozyskiwanie danych od użytkowników oraz ze świata realnego, np. przez modele agencyjne („agentic models”).

Rozbudowa etapu szkoleniowego LLMów daje niestety (a może na szczęście?) postępy logarytmiczne, a więc nawet przy zwiększeniu ilości przetwarzanych podczas treningu danych postęp jest relatywnie niewielki. Nie zwiastuje to więc dalszych przełomów, za to na pewno wiązałoby się z drastycznie większym zapotrzebowaniem zarówno energetycznym, jak i inwestycyjnym.

Wygląda na to, że postęp modeli LLM opartych o transformatory mógł już zostać wyczerpany i opiera się w tym momencie o tworzenie kolejnych nakładek korygujących jego defekty, a zarazem zwiększających koszty działania modeli. AI nadal nie jest w stanie posługiwać się abstrakcjami, tworzyć generalizacji ani modeli funkcjonowania świata. Istotny postęp wydaje się niemożliwy bez dalszych rewolucji koncepcyjnych.

Do pewnych rzeczy sztuczna inteligencja nadaje się świetnie już teraz. LLMy ułatwiają oszustwa, manipulacje i propagandę, a także inwigilację i automatyzację aparatu represji.

PODSUMOWANIE

Narzędzia sztucznej inteligencji są nadal technologią dopiero poszukującą zastosowań, a przez to starającą się kreować rzekome potrzeby. Większość LLMów to modele ogólnego przeznaczenia, a nie projekty stworzone do konkretnych zadań. Z tego wynikają poważne ograniczenia, co jest tylko dodatkowo wzmacniane przez nieświadomość przeciętnego użytkownika i interfejs symulujący interakcję z niemal realnym człowiekiem.

Do wielu z proponowanych nam usług AI w ogóle się nie nadaje, a może wręcz pogarszać funkcjonalność oprogramowania lub wyrządzać realne szkody, ale korporacje niespecjalnie się tym przejmują, bo zadowolenie użytkownika od dawna nie jest ich priorytetem. Modele generatywne są więc nam wciskane do wszelkiego oprogramowania bez zwracania uwagi na sprzeciwy.

Warto też pamiętać, iż trening modeli wymaga kradzieży i żerowania na ludzkiej twórczości, co – jak się wydaje – musi się skończyć uwspólnieniem strat i prywatyzacją ewentualnych zysków. Produkty wygenerowane przez maszyny zaśmiecają zaś wszelkie media i utrudniają dalszą działalność ludzkim twórcom.

Masowe wdrażanie sztucznej inteligencji wiąże się również z marnowaniem zasobów i konkurowaniem o nie z ludźmi. W USA mieszkańcy już teraz muszą mierzyć się ze znacznie wyższymi rachunkami za prąd i wodę. Budowa centrów obliczeniowych niezbędnych dla funkcjonowania modeli generatywnych oznacza też przekierowanie na nie gigantycznych środków finansowych, które mogłyby zostać lepiej spożytkowane. Niewyczerpane zapotrzebowanie na komponenty komputerowe podbija też ich koszty, co może odcinać od dostępu do nich zwykłych konsumentów.

Celem nadrzędnym wydaje się w tej chwili pozyskanie nowych zasobów treningowych oraz utworzenie technologicznego monopolu, który pozwoliłby na efektywną monetyzację uzasadniającą gigantyczne wydatki. Nawet jeśli prywatne dane użytkowników jeszcze nie są gromadzone, to na pewno będą, ponieważ jest to dla nich żyła przyszłego złota.

Nigdy nie należy zapominać, że modele AI należą do korporacji, więc siłą rzeczy będą działać przede wszystkim w ich interesie.

CIEKAWOSTKI

Powyższe to jednak dopiero wstępne zarysowanie tematu, a prawdziwe obawy planuję przedstawić w kolejnych postach. Najbardziej martwią mnie bowiem dwie kwestie, które zostały tutaj tylko nieśmiało zapowiedziane:

- Niemożność zrealizowania przez AI zysków oczekiwanych przez olbrzymią bańkę spekulacyjną na amerykańskim rynku.

- Potencjalnie katastrofalne wykorzystanie tego, do czego sztuczna inteligencja nadaje się świetnie już teraz.

Dodaj komentarz